InternVL入门学习资料 - 开源多模态大模型系列

2025-01-03 00:00:00 610

InternVL入门学习资料 - 开源多模态大模型系列

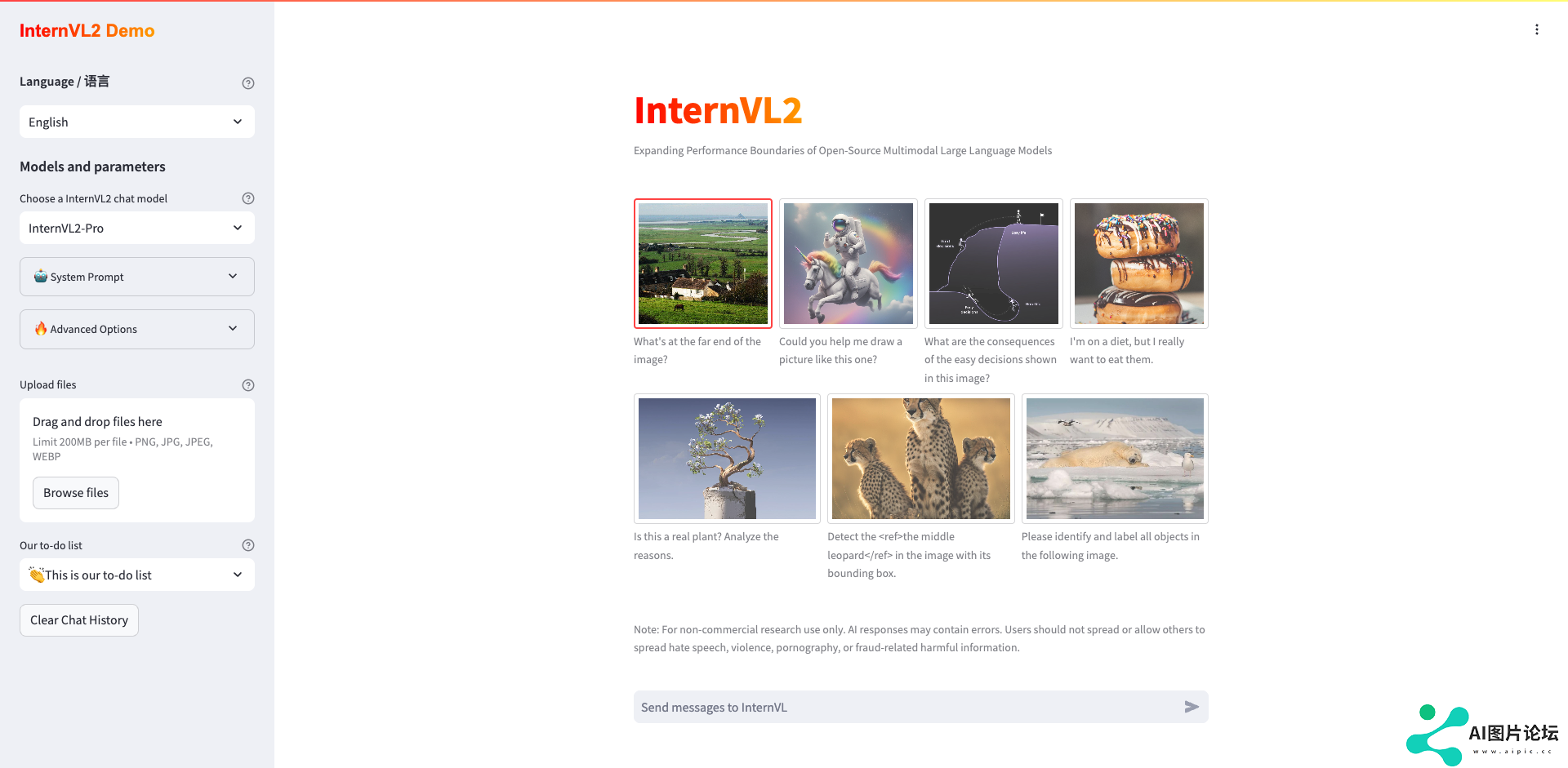

InternVL是由OpenGVLab团队开发的一系列开源多模态大模型,涵盖了视觉基础模型、视觉-语言基础模型和多模态大语言模型。本文汇总了InternVL相关的学习资源,帮助读者快速了解和使用这一开源项目。

项目概述

InternVL项目的主要特点包括:

提供了从1B到108B参数的多种规模模型支持多模态输入,包括文本、图像、视频和医疗数据支持多任务输出,如图像、边界框和分割掩码等在多个多模态基准测试中达到了与商业闭源模型相当的性能模型系列

InternVL包括以下几个系列的模型:

InternVL 2.0系列:最新的多模态大语言模型,包括1B到108B参数的多个版本。

InternVL 1.0-1.5系列:早期版本的多模态对话模型。

InternViT系列:视觉基础模型,包括300M到6B参数的版本。

InternVL 1.0系列:视觉-语言基础模型。

快速开始

要快速体验InternVL模型,可以通过以下方式:

在线Demo:

InternVL Chat DemoHugging Face Space使用Hugging Face Transformers:

from transformers import AutoTokenizer, AutoModelmodel = AutoModel.from_pretrained("OpenGVLab/InternVL-Chat-V1-5", trust_remote_code=True)tokenizer = AutoTokenizer.from_pretrained("OpenGVLab/InternVL-Chat-V1-5", trust_remote_code=True)本地部署:

Streamlit DemoGradio Demo学习资源

官方文档:

InternVL ReadTheDocs论文:

InternVL: Scaling up Vision Foundation Models and Aligning for Generic Visual-Linguistic TasksHow Far Are We to GPT-4V? Closing the Gap to Commercial Multimodal Models with Open-Source Suites博客:

InternVL Project BlogGitHub仓库:

OpenGVLab/InternVL模型下载:

Hugging Face模型仓库ModelScope模型仓库中文解读:

知乎文章: InternVL解读性能与应用

InternVL在多个多模态任务上展现了卓越的性能,包括:

视觉感知:图像分类、语义分割等跨模态检索:图像-文本检索多模态问答:如MMMU、DocVQA、ChartQA等基准测试多语言零样本分类具体的性能数据可以在官方GitHub README中查看。

结语

InternVL作为一个强大的开源多模态大模型系列,为研究人员和开发者提供了丰富的资源。通过本文提供的学习资料,读者可以深入了解InternVL的架构、性能和应用,并开始使用这些模型进行自己的研究和开发工作。

相关资讯

查看更多最新资讯

-

- 专家说很多翻译硕士水平比不上AI,但人工智能不会淘汰所有的人工

- 2025-01-15 831

-

- 为什么说“人工智能”这个词不够准确?

- 2025-01-15 1116

-

- 新壹科技:2024不断缔造AI视频生产新动能

- 2025-01-15 969

-

- 人工智能时代,编辑这一传统职业面临怎样的“变”与“不变”

- 2025-01-15 487

-

- CES 2025开幕在即!Agentic AI或成一大焦点

- 2025-01-15 1657