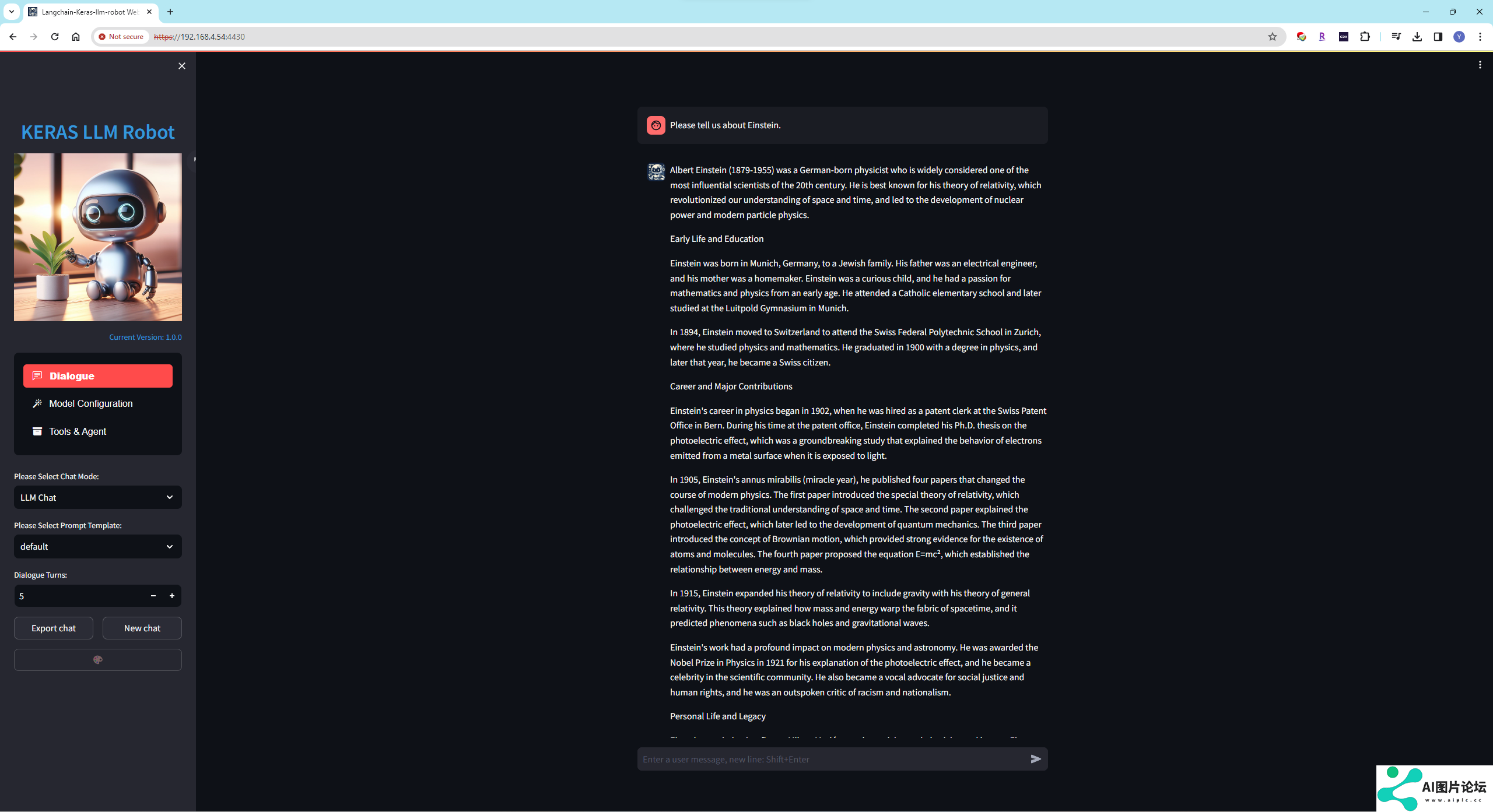

keras-llm-robot学习资料汇总 - 一个用于学习大型语言模型的Web UI项目

2025-01-03 00:00:00 1414keras-llm-robot:探索大型语言模型的强大工具

keras-llm-robot是一个功能丰富的开源项目,旨在帮助开发者学习和实践大型语言模型(LLM)。本文将为您详细介绍这个强大工具的主要特性、环境配置、使用方法等关键信息,帮助您快速上手并深入探索LLM的无限可能。

项目概览

keras-llm-robot是一个基于Web UI的项目,继承自Langchain-Chatchat项目,底层架构使用了Langchain和Fastchat等开源框架,顶层使用Streamlit实现。该项目完全开源,旨在实现大多数来自Hugging Face网站的开源模型的离线部署和测试。此外,它还允许通过配置组合多个模型,以实现多模态、RAG、Agent等功能。

主要特性

多样化的模型支持:

基础模型:支持多种LLM模型,如llama-2、chatglm等多模态模型:支持图像文本、语音文本等多模态模型特殊模型:支持量化模型(GGUF)等在线模型:支持OpenAI和Google等在线语言模型强大的辅助功能:

检索:支持本地和在线向量数据库,提供长期记忆能力代码解释器:支持本地执行和Docker沙箱执行语音识别与合成:支持本地模型和Azure在线服务图像识别与生成:支持多种图像处理模型灵活的配置选项:

模型加载:支持CPU/GPU加载,8-bit量化等知识库管理:支持多种文档类型,灵活的向量数据库选择角色扮演:支持多种预定义角色,提供专业化回复快速开始

环境配置:

conda create -n keras-llm-robot python==3.11.5conda activate keras-llm-robotgit clone https://github.com/smalltong02/keras-llm-robot.gitcd keras-llm-robotpip install -r requirements-[your_platform].txt启动Web UI:

python __webgui_server__.py --webui访问地址:http://127.0.0.1:8818

深入学习

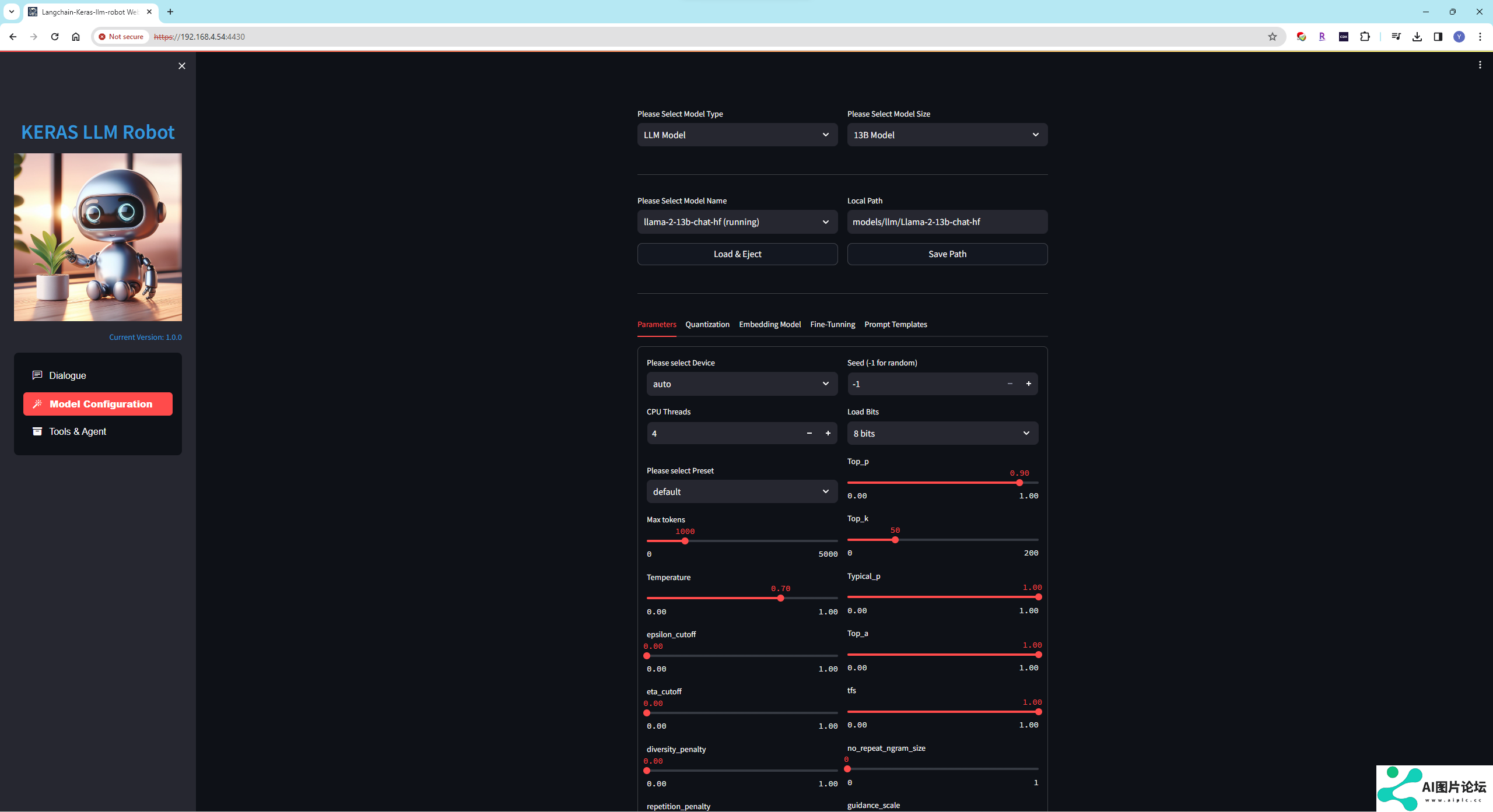

模型配置:在配置界面选择合适的语言模型加载,包括基础模型、多模态模型、特殊模型和在线模型。

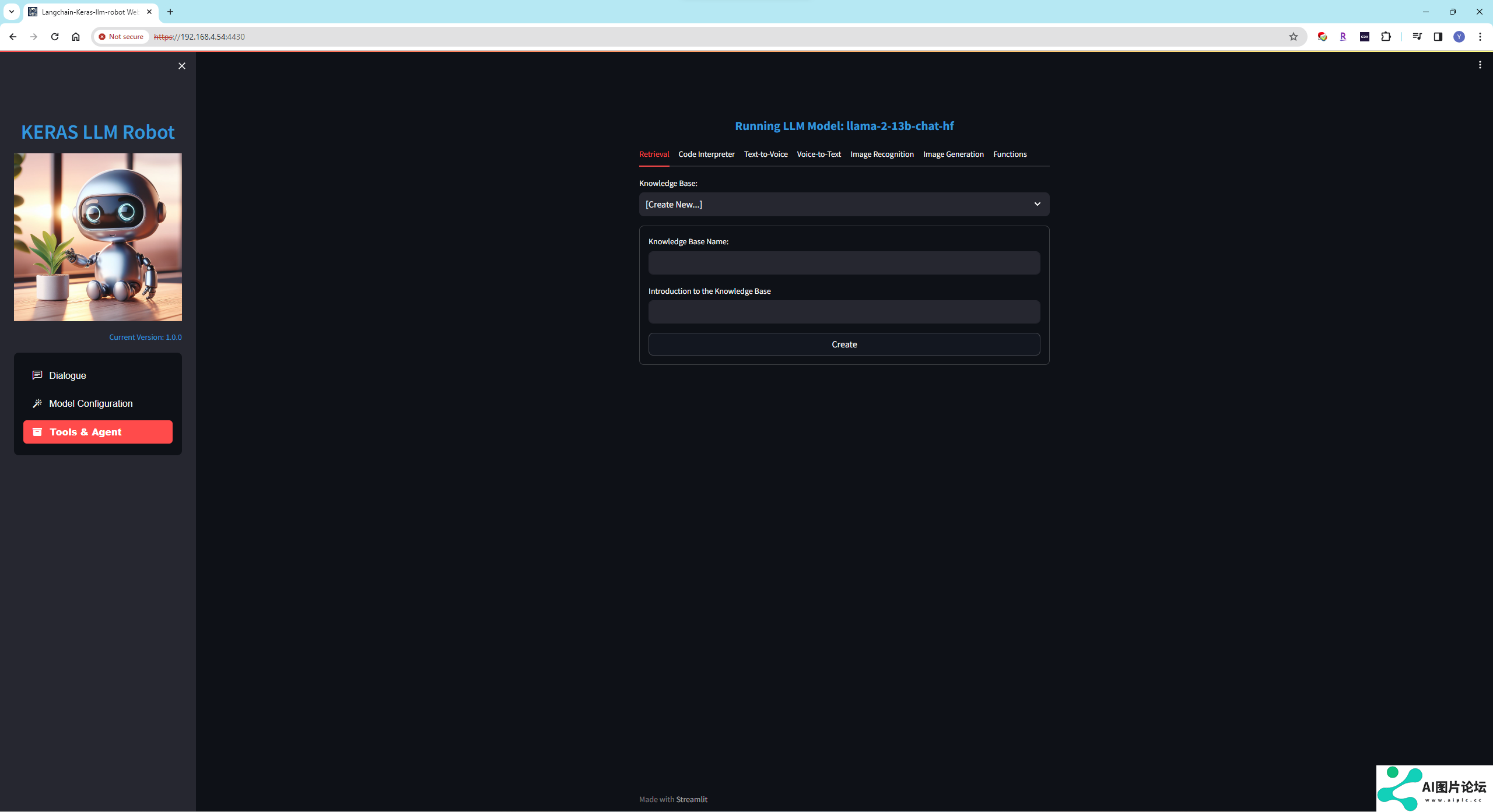

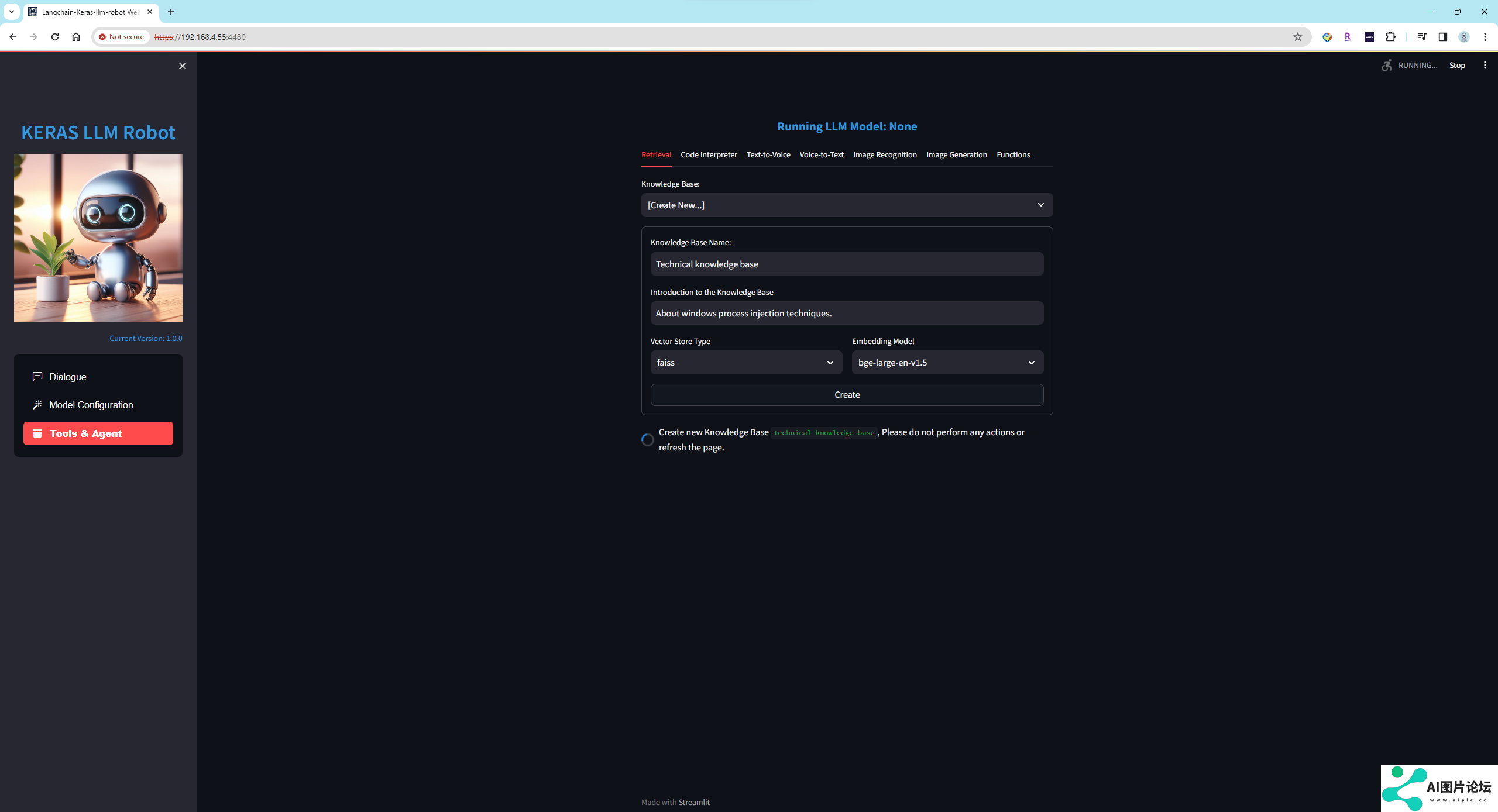

工具与Agent配置:在工具&Agent界面加载辅助模型,如检索、代码执行、语音转换等。

知识库管理:创建知识库,选择合适的向量数据库和嵌入模型,上传并管理文档。

高级功能探索:

模型量化:使用llama.cpp等工具创建量化版本的通用模型模型微调:使用私有数据集对语言模型进行微调角色扮演:让模型扮演不同角色,提供更专业的回答学习资源

官方文档:https://github.com/smalltong02/keras-llm-robot/blob/main/readme.md中文说明:https://github.com/smalltong02/keras-llm-robot/blob/main/readme-cn.md视频演示:项目正在不断更新中,请关注官方GitHub仓库获取最新视频演示keras-llm-robot为AI开发者提供了一个功能丰富、易于使用的平台,帮助我们深入学习和实践大型语言模型。无论您是AI研究人员、学生还是行业从业者,这个项目都能为您的LLM之旅提供宝贵的支持。立即开始您的探索之旅,感受AI的无限可能吧!

相关资讯

查看更多最新资讯

-

- 专家说很多翻译硕士水平比不上AI,但人工智能不会淘汰所有的人工

- 2025-01-15 1709

-

- 为什么说“人工智能”这个词不够准确?

- 2025-01-15 262

-

- 新壹科技:2024不断缔造AI视频生产新动能

- 2025-01-15 1018

-

- 人工智能时代,编辑这一传统职业面临怎样的“变”与“不变”

- 2025-01-15 1187

-

- CES 2025开幕在即!Agentic AI或成一大焦点

- 2025-01-15 1835