Baichuan2学习资料汇总 - 开源大语言模型的新一代佼佼者

2025-01-03 00:00:00 533

Baichuan2模型介绍

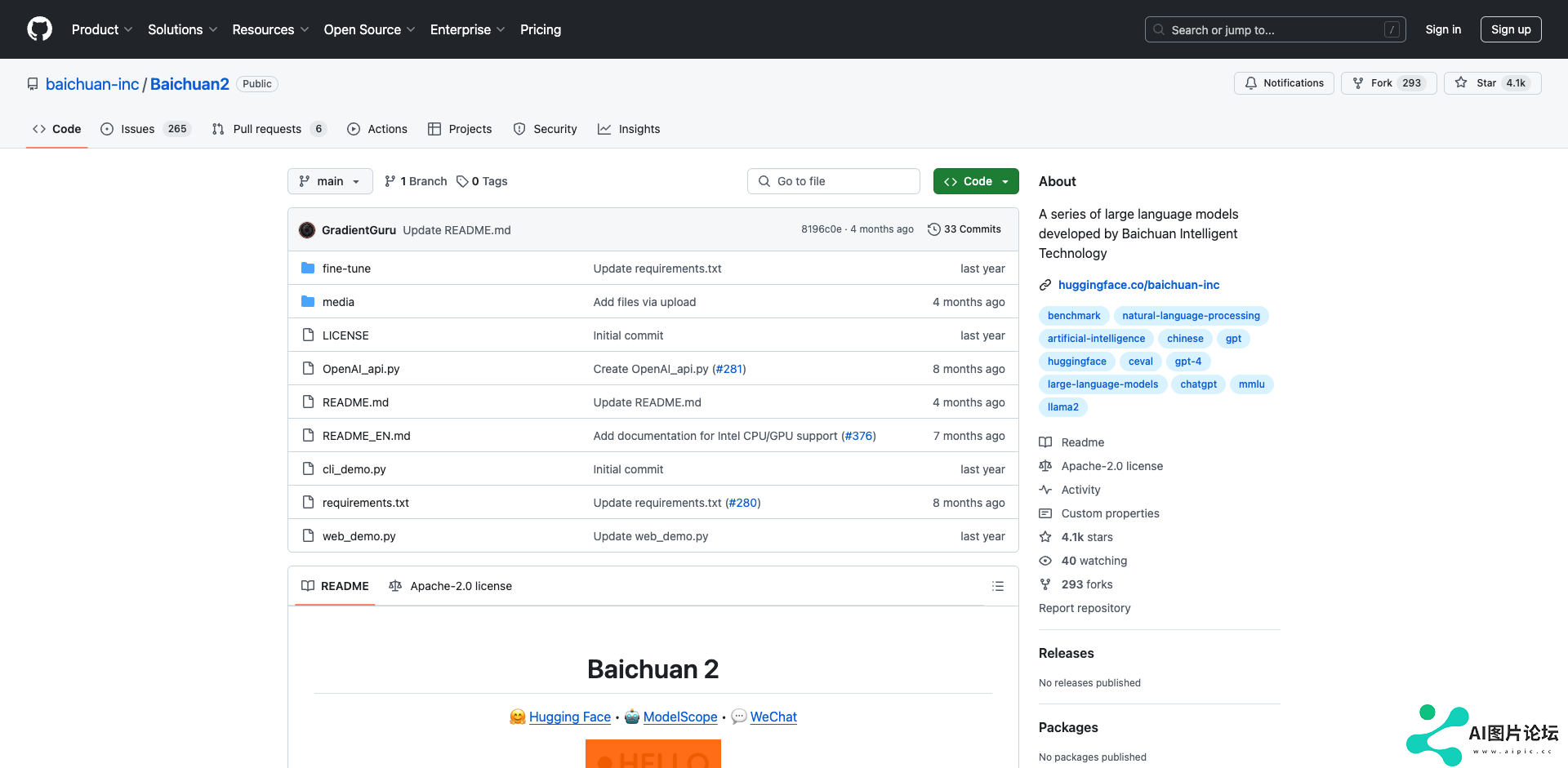

Baichuan2是百川智能推出的新一代开源大语言模型,采用2.6万亿Tokens的高质量语料训练而成。主要特点包括:

提供7B和13B两种规模,每种规模都有Base和Chat两个版本在多个权威的中文和英文基准测试中表现优异,同尺寸模型中效果最佳对学术研究完全开放,商用只需邮件申请即可免费使用支持中英文双语,在多语言翻译任务上也有不错表现模型下载与使用

Baichuan2模型可以从Hugging Face下载使用,主要版本包括:

Baichuan2-7B-BaseBaichuan2-7B-ChatBaichuan2-13B-BaseBaichuan2-13B-Chat使用示例:

import torchfrom transformers import AutoModelForCausalLM, AutoTokenizertokenizer = AutoTokenizer.from_pretrained("baichuan-inc/Baichuan2-13B-Chat", trust_remote_code=True)model = AutoModelForCausalLM.from_pretrained("baichuan-inc/Baichuan2-13B-Chat", device_map="auto", torch_dtype=torch.float16, trust_remote_code=True)messages = []messages.append({"role": "user", "content": "你好"})response = model.chat(tokenizer, messages)print(response)模型评测结果

Baichuan2在多个权威基准测试中表现优异:

C-Eval (中文): 13B版本得分58.10,7B版本得分54.00MMLU (英文): 13B版本得分59.17,7B版本得分54.16CMMLU (中文): 13B版本得分61.97,7B版本得分57.07在数学、代码、多语言翻译等领域也有不错表现,详细评测结果可查看GitHub。

更多学习资源

Baichuan2技术报告Baichuan2 GitHub仓库百川智能官网Baichuan2作为新一代开源大语言模型的佼佼者,值得研究人员和开发者深入学习和使用。欢迎访问上述资源了解更多信息!

相关资讯

查看更多最新资讯

-

- 专家说很多翻译硕士水平比不上AI,但人工智能不会淘汰所有的人工

- 2025-01-15 1450

-

- 为什么说“人工智能”这个词不够准确?

- 2025-01-15 515

-

- 新壹科技:2024不断缔造AI视频生产新动能

- 2025-01-15 1054

-

- 人工智能时代,编辑这一传统职业面临怎样的“变”与“不变”

- 2025-01-15 1659

-

- CES 2025开幕在即!Agentic AI或成一大焦点

- 2025-01-15 1579